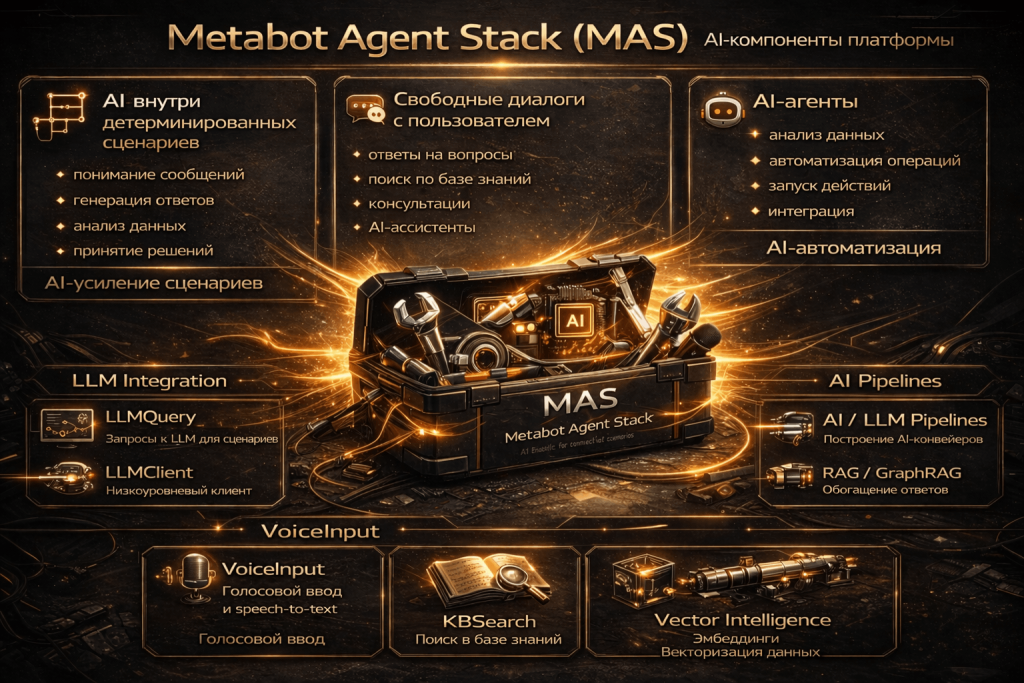

Metabot Agent Stack (MAS) — это набор AI-компонентов платформы Metabot, который позволяет встраивать искусственный интеллект внутрь сценариев, диалогов и бизнес-процессов.

Это не просто “чат с ИИ” и не отдельный агент, живущий сам по себе.

Это AI-runtime внутри Metabot, где интеллект работает как управляемый слой системы: анализирует свободный текст и голос, обращается к знаниям, возвращает структуру, помогает принимать решения внутри сценария — но не заменяет сам сценарий.

---

Обычный сценарий хорошо работает, пока пользователь отвечает строго по структуре:

* нажимает кнопки

* выбирает варианты

* идёт по заранее заданным веткам

Но в реальном диалоге это быстро ломается.

Например, сценарий ожидает:

Выберите тип проблемы

А пользователь пишет:

Соседи сверху топают, слышу шаги и телевизор через потолок

Для дерева условий это шум.

Для Metabot Agent Stack — это нормальный вход в AI-сценарий.

Здесь подключается LLM Query: компонент, который анализирует сообщение, извлекает смысл и возвращает структурированный результат, после чего сценарий продолжает работу уже в понятной и управляемой логике.

---

Типовой паттерн выглядит так:

вопрос сценария

→ ответ пользователя

→ AI-компонент

→ структурированный результат

→ следующий шаг сценария

Например:

json<br />

{<br />

"problem_type": "ударный шум",<br />

"source": "потолок",<br />

"room_type": "спальня"<br />

}<br />

То есть AI здесь не заменяет сценарий.

Он помогает сценарию:

* понять свободный ввод

* извлечь структуру

* обработать голос

* найти знания

* и продолжить процесс без потери контроля

---

Metabot Agent Stack нужен там, где одного дерева условий уже недостаточно,

но при этом нельзя потерять управляемость процесса.

AI здесь выполняет роль:

* семантического анализа

* интеллектуального вычислительного узла

* обработки свободного текста

* поиска по базе знаний

* работы с голосом

* извлечения структуры

* генерации ответа в рамках логики сценария

То есть MAS — это не “бот с ИИ”.

Это сценарная система со встроенным AI-слоем.

---

На рынке обычно есть два полюса:

Они хорошо умеют:

* кнопки

* ветки

* анкеты

* воронки

* рассылки

Но как только нужно:

* понимать свободный текст

* использовать голос

* работать с базой знаний

* извлекать сущности

* встраивать интеллект в процесс

архитектура начинает ломаться или обрастать костылями.

Они умеют:

* общаться свободно

* рассуждать

* генерировать текст

* использовать инструменты

Но у них часто нет:

* сценарной архитектуры

* предсказуемой логики переходов

* управляемого контракта ответа

* контроля пользовательской траектории

* встроенной бизнес-логики

Metabot Agent Stack соединяет эти два мира.

Ты получаешь:

* управляемость сценарной платформы

* гибкость AI-компонентов

* расширяемость через код и плагины

* возможность строить AI-процессы без потери контроля

---

Главный AI-компонент для сценариев.

Позволяет:

* отправить запрос в языковую модель

* передать контекст и промпт

* получить текст или JSON

* сохранить результат в атрибуты

* продолжить сценарий по логике

Подходит для анализа сообщений, классификации, извлечения структуры, определения намерения, профилирования и генерации ответа.

---

Компонент голосового ввода.

Позволяет:

* принимать голосовые сообщения

* распознавать речь

* передавать результат дальше в сценарий

* использовать голос как полноценный входной интерфейс

---

Компонент работы с базой знаний.

Используется для:

* FAQ

* инструкций

* продуктовых описаний

* внутренних регламентов

* корпоративных знаний

Позволяет строить knowledge-based ответы и снижать галлюцинации модели.

---

Контур управления промптами.

Позволяет:

* выносить промпты из кода

* хранить их в таблицах

* переиспользовать

* версионировать

* разделять по задачам и агентам

Это важно там, где AI становится частью продукта, а не разовой настройкой.

---

Низкоуровневый AI-клиент для инженеров и интеграторов.

Отвечает за:

* сборку промптов

* transport

* fallback-логику

* конфигурацию моделей

* обработку ответа

* трассировку

---

Встроенная трассировка AI-процессов.

Позволяет видеть:

* какой промпт ушёл

* какой ответ пришёл

* сколько занял запрос

* какие токены были израсходованы

* где возникла ошибка

Это делает AI-процессы объяснимыми, отлаживаемыми и пригодными для реальной эксплуатации.

---

| Уровень | Для кого | Что внутри |

| --------------------- | --------------------------------- | ----------------------------------------------------------------- |

| High-level | сценаристы и low-code специалисты | LLM Query, Voice Input, Knowledge Base Search, Prompt Registry |

| Engineering layer | инженеры и интеграторы | LLM Client, transport, async execution, fallback, runtime control |

| Infrastructure | надёжность и масштабирование | knowledge base, storage, tracing, observability, state |

---

На базе Metabot Agent Stack можно запускать:

* AI-консультантов по базе знаний

* продуктовые ассистенты

* support-сценарии и сервисные боты

* голосовые интерфейсы

* AI-квалификацию лидов

* профилирование пользователей

* маршрутизацию сложных запросов

* внутренние ассистенты для команд

* гибридные AI-сценарии с данными и API

---

В испытании без алиби ты получаешь не “магический AI”, а доступ к стеку, логике и компонентам, через которые интеллект становится частью управляемой системы.

Тебе открываются:

* описание архитектуры MAS

* документация по компонентам

* понимание того, как AI встраивается в сценарий

* примеры практического использования

* связь между сценарием, интеллектом, данными и ответственностью

Задача здесь не просто “посмотреть на AI”.

Задача — понять:

как интеллект работает внутри системы

и почему ответственность всё равно остаётся на человеке

---

Если ты уже проходил Orion, то ты, скорее всего, видел часть компонентов MAS в работе.

Например, в профилировании используются:

* LLM Query

* Voice Input

* AI-обработка ответов внутри сценария

То есть Metabot Agent Stack — это не абстрактный набор функций,

а уже работающий слой внутри реальной системы.

---

Испытание без алиби посвящено не “восхищению ИИ”, а позиции оператора.

Именно поэтому MAS здесь важен:

* он показывает, что интеллект можно встроить в процесс

* показывает, что AI — это не магия, а архитектурный слой

* помогает увидеть, где заканчивается модель и начинается ответственность человека

* даёт практический язык для работы с AI-системами без сакрализации

---

Metabot Agent Stack — это не набор разрозненных AI-функций.

Это целостная компонентная архитектура для управляемых AI-процессов внутри платформы Metabot.

Ты не выбираешь между:

* жёстким сценарием без интеллекта

* и свободным AI без контроля

Ты получаешь третью модель:

сценарий + интеллект + данные + голос + знания + инженерная управляемость

в одной системе.

---

Подробная документация по стеку, компонентам и инженерным возможностям доступна здесь:

👉 Открыть документацию Metabot Agent Stack

Если хочешь глубже разобраться в разработке, конфигурации и практических сценариях использования — начинай оттуда.

---

Metabot Agent Stack — это AI-runtime для сценариев, диалогов и управляемых AI-процессов внутри Metabot.